Wenn man ehrlich ist, geht es bei Grounding nicht um Magie, sondern ums schlichte Faktenchecken – nur diesmal bei Maschinen, die manchmal mehr Selbstbewusstsein als Wahrheitsliebe haben. Du könntest sagen: Es ist der Versuch, große Sprachmodelle zu erden. Statt sich auf ihr instinktives „Ich antworte einfach irgendwas“ zu verlassen, holen sie sich bei Grounding zusätzliche, überprüfbare Informationen – so wie jemand, der vor dem Reden kurz in Google nachschaut, ob das, was er behauptet, überhaupt stimmt.

Warum Grounding wichtig geworden ist

Wir leben in einer Zeit, in der KI-Modelle mit unerschütterlicher Überzeugung völligen Blödsinn erzählen. Das Problem liegt in ihrer Struktur: Ein Sprachmodell ist darauf trainiert, etwas zu sagen, nicht unbedingt etwas Wahres. Wenn du fragst „Wie alt ist der Mond?“, wählt es einfach die wahrscheinlichste Wortfolge – unabhängig davon, ob sie korrekt ist. Grounding versucht, diesen Prozess realitätsnäher zu machen, indem das Modell seine Antwort mit echten Daten abgleicht.

Das Prinzip ist dabei erschreckend einfach: Wenn das Modell merkt, dass es keine ausreichende Sicherheit für eine Antwort hat, ruft es vertrauenswürdige externe Quellen auf – etwa interne Dokumente, wissenschaftliche Datenbanken oder auch das Web – um die eigene Aussage zu prüfen oder zu ergänzen.

Ein kurzer Überblick: Was hinter RAG steckt

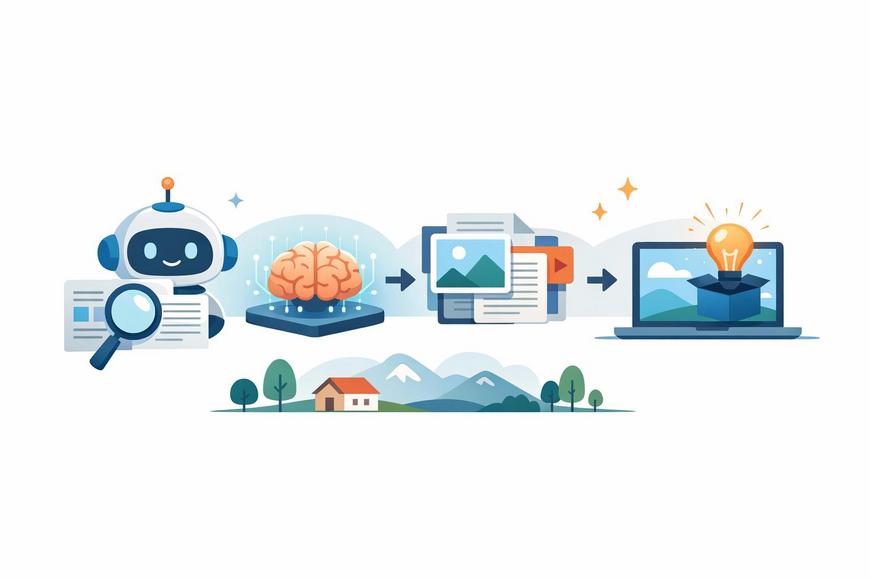

RAG steht für Retrieval-Augmented Generation. Klingt trocken, ist aber im Grunde die populärste Ausprägung von Grounding. RAG verbindet zwei Dinge: die Fähigkeit großer Sprachmodelle, natürliche Sprache zu generieren, und die Fähigkeit von Suchsystemen, passende Informationen zu finden. Das Modell sucht also zuerst relevante Inhalte, nutzt sie anschließend, um eine bessere Antwort zu bauen – quasi wie eine Mischung aus Suchmaschine und Erzähler.

Ein Beispiel: Stell dir vor, du fragst eine KI nach den neuesten Ergebnissen eines Fußballspiels. Da ihr Training vielleicht Monate alt ist, weiß sie das Ergebnis nicht. Mit RAG durchsucht sie aktuelle Quellen, findet die Information und generiert darauf basierend die Antwort. So entsteht eine fundierte, aktuelle Aussage, statt einer Halluzination.

Warum wir RAG brauchen

Je größer die Modelle werden, desto älter ist meist ihr Wissen. Viele von ihnen wurden zuletzt 2024 oder früher mit Daten gefüttert. Alles, was danach passiert, existiert für sie schlichtweg nicht. RAG füllt diese Lücke. Es ist günstiger, neue Informationen abzurufen, als das gesamte Modell wieder zu trainieren – was Millionen kostet und Wochen dauert.

Und vielleicht das Wichtigste: RAG reduziert die Halluzinationsneigung – also das Phänomen, dass KI selbstbewusst Dinge erfindet. Wenn es funktioniert, ersetzt es das Bauchgefühl der Maschine durch überprüfte Fakten.

Grounding vs. RAG – ist das dasselbe?

Nicht ganz. RAG ist das technische Verfahren, um Grounding zu erreichen. Grounding ist das Ziel – also eine Antwort, die auf überprüften, realen Daten basiert. RAG ist der Weg dorthin. Das Modell nutzt externe Informationen, um eine bessere, sicherere Antwort zu erzeugen.

Man kann Grounding aber auch anders umsetzen – etwa durch Fine-Tuning (ein Modell gezielt weitertrainieren), durch regelbasiertes Prompting oder durch das Einbauen fester Wissensquellen. Egal welche Methode – alle dienen demselben Ziel: Aus den Halluzinationen eine sachliche Aussage machen.

Warum KI halluziniert – und das wohl nie ganz aufhört

Sprachmodelle sind darauf trainiert, Wahrscheinlichkeiten zu berechnen, nicht Fakten zu prüfen. Wenn ein bestimmter Fakt im Training häufig vorkommt, wird er richtig wiedergegeben. Wenn er selten war, füllt das Modell die Lücke kreativ aus. Diese sogenannten Singletons – also einmalige oder seltene Informationen – sind die Hauptquellen von Fantasiegeschichten.

Das Fatale: Selbst wenn das Training völlig fehlerfrei wäre, entstehen Fehler, weil das Modell gelernt hat, Antworten zu liefern – und dafür belohnt wird. In den Trainingsprozessen zählt Belohnung zu stark, Korrektheit zu wenig. Deshalb halluziniert auch ein modernes Modell noch regelmäßig – nur etwas stilvoller.

Die menschliche Parallele

Wenn du jemanden fragst, wie viel Prozent des Gehirns wir nutzen, sagen viele ganz sicher „10 Prozent!“ – obwohl das falsch ist. Sie haben es oft gehört und sagen es überzeugt weiter. Ein Sprachmodell funktioniert ähnlich: Sicherheit simulieren, auch wenn die Basis zweifelhaft ist.

Wie der RAG-Prozess technisch funktioniert

Auch wenn du kein Datenwissenschaftler bist, kannst du den Ablauf grob nachvollziehen:

- Du stellst eine Frage.

- Das Modell wandelt sie mathematisch in einen Vektor um (also eine Zahlenreihe, die den semantischen Inhalt deiner Frage repräsentiert).

- Diese Darstellung wird mit gespeicherten Inhalten verglichen – per Ähnlichkeitsmessung (zum Beispiel Cosine Similarity).

- Wenn die Übereinstimmung nicht hoch genug ist, sucht das System in externen Quellen weiter.

- Gefundene Informationen werden wieder in Text verwandelt und mit der ursprünglichen Antwort kombiniert.

- Das Ergebnis ist eine „geerdete“ Antwort, die interne und externe Daten verbindet.

RAG erinnert also an eine Suchmaschine, die dein Modell benutzt, bevor es antwortet. Es liest nach, fasst zusammen und formuliert – alles in Sekunden.

Parametrisches vs. nicht-parametrisches Wissen

Wenn du mit dem Begriff Parametric Memory arbeitest, geht es um das, was das Modell intern gelernt hat – also gespeichertes Sprachverständnis. Das sind Muster, Beziehungen, Wahrscheinlichkeiten. Dieses Wissen ändert sich nicht, bis das Modell neu trainiert wird.

Non-Parametric Memory ist dagegen alles, was außerhalb des Modells gespeichert ist: Datenbanken, Webseiten, Dokumente. Beim Grounding greift das Modell auf diese externen Speicher zu. So entstehen Antworten, die gleichzeitig flüssig formuliert und inhaltlich korrekt sind.

Warum das Ganze für SEO-Menschen plötzlich spannend wird

Wenn du SEO betreibst, betrifft dich Grounding direkt. Immer mehr KI-basierte Suchsysteme – also die sogenannten Answer Engines – greifen auf externe Quellen über RAG zurück. Und welche Seiten sie dabei berücksichtigen, hängt stark davon ab, wer im Suchindex ganz vorn steht und wie relevant der Inhalt strukturiert ist.

Mit anderen Worten: Wenn deine Seite gut rankt und verständlich formuliert ist, steigerst du die Chance, dass sie in ein KI-generiertes Ergebnis einfließt. Du spielst nicht nur für Google, sondern auch für die nachgelagerten Modelle, die Google-Suchergebnisse anzapfen.

Was du dafür tun kannst

- Optimiere die Inhalte auf präzise, klar formulierte Antworten.

- Vermeide schwammige Passagen – maschinelle Systeme müssen Kontext eindeutig erfassen können.

- Nutze Tabellen oder Listen, die Informationen klar strukturieren.

- Antworte früh im Text auf die zentrale Frage – KI liest selten den ganzen Absatz.

Oder etwas salopper gesagt: Schreib so, dass selbst ein Roboter keine Ausrede findet, dich zu ignorieren.

Chunking – die Kunst der Informationshäppchen

Ein weniger beachtetes, aber entscheidendes Detail im RAG-Prozess sind die sogenannten Chunks – also Textabschnitte, in denen Inhalte gespeichert werden. Ein zu langer Abschnitt kann den Kontext verwässern, zu kurze liefern zu wenig Information. Studien zeigen, dass sich Textabschnitte von etwa 200–500 Zeichen besonders gut für die KI-Verarbeitung eignen. So bleiben sie klar und gezielt abrufbar.

Für Websites bedeutet das: je sauberer der Inhalt gegliedert ist, desto eher wird er zum Baustein für eine Antwort. Unklare, redundante oder verschachtelte Absätze dagegen verschwinden in der digitalen Bedeutungslosigkeit.

RAG und der ewige Drahtseilakt zwischen Präzision und Kosten

Das Schöne an RAG ist seine Effizienz. Anstatt ein riesiges Modell neu zu trainieren, reicht eine Schnittstelle zur Suche. Für Unternehmen spart das enorm Ressourcen. Gleichzeitig kann das System flexibel auf neue Themen reagieren – man muss es nur auf neue Datenquellen zeigen.

Aber: Grounding ist kein Allheilmittel. Selbst mit hochwertiger Recherche bleibt der KI-Kern derselbe Wahrscheinlichkeitsgenerator. RAG lindert die Symptome, behebt aber nicht die Ursache – dass Modelle nicht wissen, sondern raten.

Die menschliche Analogie

Denk an RAG wie an ein cleveres Teammitglied, das zu schnell redet, aber zwischendurch kurz googelt, bevor es weiterspricht. Es bleibt fehleranfällig, aber die Trefferquote steigt. Ganz los wirst du die Irrtümer wohl nie – nur seltener und eleganter präsentiert.

Schlussgedanken: Was heißt das nun praktisch für dich?

Grounding ist im KI-Kosmos so etwas wie gesunder Menschenverstand – eine zweite Meinung für Maschinen. Für dich heißt das konkret:

- Wenn du Content produzierst, der in Suchsystemen sichtbar ist, wirst du künftig nicht nur für Menschen, sondern auch für Maschinen schreiben.

- Google-Rankings bleiben wichtig, weil KI-Modelle gute Positionen als Anzeichen für Autorität werten.

- Klare Informationsstrukturen, sauberer Sprachgebrauch und Quellenangaben erhöhen deine Chance, Teil künftiger Antworten zu werden.

- Und ganz banal: Reduziere das Rauschen – so wenig Blabla wie möglich, so viel Substanz wie nötig.

Oder anders gesagt: Die Regeln für gute SEO treffen sich immer stärker mit den Regeln für gutes maschinelles Verständnis. Wenn du für Grounding optimierst, optimierst du auch für Suchmaschinen – und umgekehrt.

Fazit

Grounding und RAG sind keine Wunderwerkzeuge, aber sie holen KI ein Stück weit auf den Boden der Tatsachen. Ohne sie bleibt das Netz ein Ort, an dem Maschinen halluzinieren und Menschen ihnen glauben. Mit ihnen können wir wenigstens versuchen, wieder auf das Wesentliche zurückzukommen: Wissen statt bloß Wörter.

Und in einer Welt, in der vieles Algorithmus-getrieben wirkt, ist das vielleicht die bodenständigste Entwicklung überhaupt.